Mit dem Aufkommen generativer KI-Werkzeuge, wie ChatGPT, Bing Chat und Googles Bard sowie den Bilder erzeugenden Tools, wie DALL·E 2, Midjourney oder Stable Diffusion, ist Künstliche Intelligenz plötzlich in das Rampenlicht der Öffentlichkeit gerückt.

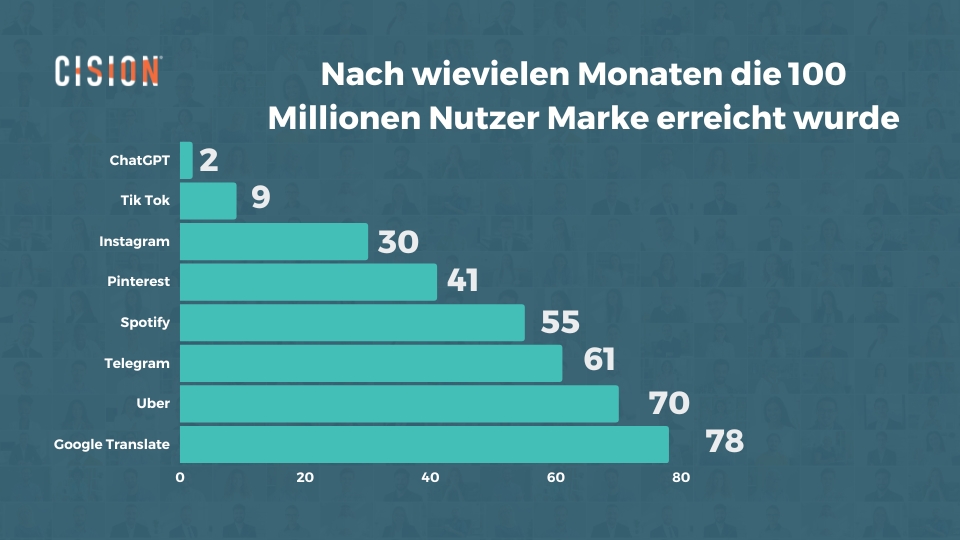

Um das enorme Wachstums-Tempo von KI-Technologien zu verstehen, braucht man nur einen Blick auf ChatGPT zu werfen, das im Januar 2023, nach gerade einmal 2 Monaten, die Marke von 100 Millionen aktiven Nutzern überschritten hat und damit die am schnellsten wachsende Verbraucheranwendung in der Geschichte bisher ist. Zum Vergleich: die Video-Plattform TikTok benötigte neun Monate, um die Anzahl von 100 Millionen Nutzern zu erreichen, Instagram sogar zweieinhalb Jahre.

Die schnelle Verbreitung von generativer KI

Generative KI dringt schnell in viele verschiedene Sektoren und Branchen vor, und die Welt der Kommunikation - eine Welt, die von Worten und Bildern bestimmt wird - hat bereits begonnen, sie zu nutzen. Mit der zunehmenden Akzeptanz steigt auch die Zahl der Inhalte, die durch generative KI-Technologien erstellt werden: von Texten und Bildern, über Videos und Audio-Inhalte. In diesem Zusammenhang spricht man von „synthetischen Medien“. In dem Maße, in dem diese Inhaltsgeneratoren für Experimente und die Produktentwicklung in größerem Umfang zur Verfügung stehen, ist es von entscheidender Bedeutung zu verstehen, wie synthetische Medien die menschliche Intelligenz und Expertise ergänzen können, die für eine effektive Kommunikation erforderlich ist.

Diese sich schnell entwickelnden und bereits sehr kontrovers diskutierten Technologien haben bereits jetzt erhebliche Auswirkungen auf die Kommunikationsbranche, Tendenz steigend. Im Jahr 2023 und darüber hinaus müssen strategische Kommunikatoren und PR-Fachleute also die Chancen und Herausforderungen verstehen, die generative KI und synthetische Medien bieten. Die Kommunikationsbranche im weiteren Sinne muss sicherstellen, dass sie KI-basierte Technologien auf ethische und verantwortungsvolle Weise einsetzt und gleichzeitig die von Menschen geleitete Kreativität und berufliche Entwicklung schützt und in diese investiert.

Veränderung der Dynamik des Möglichen

KI-Technologien können effektiv eingesetzt werden, um Kommunikationsexpert:innen und PR-Profis bei Routineaufgaben zu unterstützen, z. B. bei der Entwicklung des Grundgerüstes einer Pressemitteilung, von Blogbeiträgen oder Produkt-/E-Commerce-Texten, bei der Strukturierung und dem Clustern von SEO-relevanten Keywords für Online-Inhalte, bei der Erstellung von Listen der anzusprechenden Medien und weiteren Aufgaben.

Marken können auch noch weiter gehen, indem sie KI-Tools dazu einsetzen, um Audioversionen von Pressemitteilungen oder Webinhalten zu erstellen oder den Zugang zu Inhalten durch Text-zu-Sprache-Funktionen zu unterstützen, die es Menschen mit Sehbehinderungen ermöglichen, zu kommunizieren. Generative KI wird inzwischen auch in viele Social-Media-Publishing-Plattformen integriert, so dass die Nutzer Texte und Bilder erstellen können, die über die Markenkanäle veröffentlicht werden.

Aber KI-Inhaltsgeneratoren sind nicht nur Werkzeuge, die bestehende Aufgaben besser erledigen, sondern sie haben auch das Potenzial, völlig neue Dinge mit Inhalten zu tun. Ein Beispiel dafür ist der Ansatz der BBC, mit Hilfe von KI "flexible Medien" zu schaffen, bei denen die Inhalte dynamisch an die Umgebung der Nutzer angepasst werden. Ein Nachrichtenartikel auf einem Smartphone kann zwischen Text, Video oder Audio wechseln, so dass der Herausgeber Geschichten auf unterschiedliche Weise für verschiedene Zielgruppen erzählen kann. Die künstliche Intelligenz sorgt dafür, dass die verschiedenen Versionen ein und desselben Artikels erstellt werden.

Um wettbewerbsfähig zu bleiben, müssen Kommunikations-Profis immer auf dem Laufenden bleiben, was KI-Trends angeht und wie Medienunternehmen und Marken diese Technologien einsetzen.

Wie Jay Webster, Chief Product & Technology Officer von Cision, in einem Artikel für die Public Relations Society of America schrieb, entwickelt sich die generative KI schnell weiter, muss aber den menschlichen Input beibehalten. "Künstliche Intelligenz bei der Erstellung von Inhalten geht über Anwendungen wie SEO hinaus und öffnet die Tür zu datengesteuerten Erzählungen und vollwertiger Inhaltserstellung. Es gibt KI-basierte Tools für natürliche Sprache, die Texte für einfache Pressemitteilungen erstellen können, die dann von einem menschlichen Autor verfeinert werden."

Käufer, aufgepasst

Obwohl die Anwendung von KI-Tools im PR-Bereich enormes Potential besitzt, gibt es ebenso viele Risiken. Das hat mitunter damit zu tun, wie speziell generative KI-Tools, die auf Large Language Models (kurz: LLMs) basieren, trainiert werden. Für das Training werden enorme Datensätze genutzt. Die Künstliche Intelligenz erkennt Muster in diesen Datenmengen. Bei einer Frage oder Eingabe (Prompt), die an die KI gestellt wird, antwortet diese im Grunde auf der Basis, welches Wort in einem bestimmten Kontext mit der höchsten Wahrscheinlichkeit auf ein anders Wort folgt. Diese Vermutung ist nur so gut wie die Daten, auf denen sie trainiert wurde. Aus diesem Grund müssen Kommunikationsteams sicherstellen, dass ihre Daten ausreichend umfangreich sind, damit die KI-Anwendung in der Lage ist, adäquate Ergebnisse auszuliefern.

Angenommen, eine Anwendung würde dazu entwickelt, um Marketing-Texter zu unterstützen. Dazu würde man sie aber ausschließlich mit Daten von Twitter und öffentlich zugänglichen Facebook-Seiten trainieren. Als Resultat würde sie bei der Erstellung von Inhalten lediglich solche produzieren, die auf der Art und Weise basieren, wie andere Marken bereits auf diesen beiden Plattformen kommuniziert haben. Die Ergebnisse wären qualitativ beschränkt, auf Grund der beschränkten Datenmenge, mit der die Anwendung trainiert wurde.

Auch wenn die technologische Entwicklung schnell voranschreitet, zeigen zahlreiche Medienberichte ebenso wie Aussagen von KI-Experten aus aller Welt, dass es noch ein weiter Weg im Bereich der KI-Anwendungen ist, bevor diese verlässliche und sachlich korrekte Inhalte verfassen können – sei es als Chatbot, der Konversationen imitiert oder als Anwendung, die lange Texte verfasst.

Aus diesen Gründen müssen Menschen, die Generatoren synthetischer Medien nutzen, ihr Bewusstsein für die Prompts schärfen, die sie erstellen, um entsprechende Resultate zu erhalten. ChatGPT, ebenso wie andere Anwendungen, können nur dann gute Ergebnisse abliefern, wenn die Prompts ebenfalls eindeutig und gut strukturiert sind. Wenn sie das System mit falschen Informationen füttern, ist es nicht in der Lage, ihnen hilfreiche Informationen zur Verfügung zu stellen.

Eine weitere Tücke ist, dass Sprache oder Bilder, die in Anfragen verwendet werden, unbewusste Vorurteile enthalten können. Das kann sich auch auf die Antworten bzw. Resultate der Anwendungen auswirken.

Aus diesen Gründen ist es wichtig, dass man sich als Anwendern intensiv mit den Technologien und ihren Funktionsweisen auseinandersetzt. Auch wenn diese immer weiterentwickelt und ihre Fehleranfälligkeit vermindert wird, sollten Kommunikationsprofis aktiv sich um ein besseres Verständnis der Technologien bemühen.

5 Dinge, die Sie über generative KI wissen müssen:

KI-generierte Inhalte können nach dem geltenden Recht zum Schutz des geistigen Eigentums nicht urheberrechtlich geschützt werden; sie werden sofort Teil der Public Domain. Nur Inhalte, die von Menschen geschaffen wurden, können durch das US-Urheberrecht geschützt werden.

Die deutsche Website urheberrecht.de verweist in ihrem Beitrag zum Thema „Künstliche Intelligenz“ und in Bezug auf die Frage, ob „KI ein Urheber sein kann“ auf das deutsche Urheberrechtsgesetz (UrhG) hin:

"Laut Urheberrechtsgesetz (UrhG) handelt es sich bei einem Urheber um den Schöpfer eines Werkes. Eine künstliche Intelligenz kann laut Urheberrecht allerdings keine Werke erschaffen, da es sich dabei um persönliche geistige Schöpfungen handelt."

Da KI-Algorithmen auf große Mengen bestehender Inhalte trainiert werden, besteht das Risiko, dass die ursprünglichen Urheber dieser Inhalte Urheberrechtsverletzungen geltend machen könnten, die auf der Verwendung ihres geistigen Eigentums beim Training der KI oder in den von ihr produzierten Inhalten beruhen. So hat beispielsweise die Stockfoto-Plattform Getty Images und mehrere einzelne Künstler bereits gegen Unternehmen geklagt, die Pionierarbeit bei der Generierung von KI-Bildern leisten, weil sie ihre Bilder und künstlerischen Stile verwenden.

KI, die auf fehlerhafte Inhalte trainiert wurde, kann Vorurteile und Stereotypen aufrechterhalten oder Inhalte erzeugen, die irreführend oder schlichtweg falsch sind.

Synthetische Medien werden bereits in böser Absicht eingesetzt, etwa um Fake News zu verbreiten. Eine ausgefeilte Medienbeobachtung ist entscheidend, um Fehlinformationen oder Fake News zu erkennen, die dem Ruf Ihrer Marke schaden könnten, und darauf zu reagieren, bevor sie sich durchsetzen.

Es kann schwierig sein, den Ursprung und die Authentizität von maschinell erzeugten Inhalten zu überprüfen, was das Vertrauen in die PR-Branche und in die Medien im Allgemeinen untergraben kann. Es ist noch zu früh, um zu sagen, welche Schutzmaßnahmen - wenn überhaupt - in den USA oder international gesetzlich festgelegt werden. Die politischen Entscheidungsträger sind jedoch bereits dabei, sich mit diesem Thema zu befassen. In den USA hat die National Telecommunications and Information Administration (NTIA) des Handelsministeriums vor kurzem eine Aufforderung zur Stellungnahme (RFC) zur KI-Rechenschaftspflicht veröffentlicht. Im Vereinigten Königreich wurde kürzlich ein Whitepaper veröffentlicht, in dem es um "verantwortungsvolle Innovation und die Wahrung des öffentlichen Vertrauens in diese revolutionäre Technologie" geht.

Menschliche Kreativität verbessern - nicht ersetzen

In dem Maße, wie KI allgegenwärtig wird, müssen sich PR-Fachleute der Vorteile und Vorbehalte bewusst sein, die KI-Innovationen bieten. Für die effektivsten Anwendungen dieser neuen Technologien wird das menschliche Element weiterhin unerlässlich sein.

Antony Cousins, Executive Director of AI Strategy bei Cision, sagte gegenüber PRWeek: "KI fehlt das Einfühlungsvermögen und die Kreativität, die nur ein Mensch mit einem absoluten Verständnis für ein Problem lösen kann, und sie ist noch nicht einmal im Entferntesten bereit, uns beim Aufbau und der Pflege der Beziehungen zu helfen, die vielen von uns den Erfolg ermöglichen."

Man könnte eine KI-gestützte Softwarelösung verwenden, um eine Gliederung für eine Fallstudie oder eine Pressemitteilung zu verfassen oder um Bilder für soziale Medien zu generieren, die das größte Potenzial für das Engagement der Verbraucher haben. Um die Genauigkeit zu gewährleisten, müssen solche Inhalte jedoch immer noch von Menschen mit Fachkenntnissen geprüft, bewertet und optimiert werden.

Denken Sie daran, dass Tools wie ChatGPT Ihre Frage lesen und eine Antwort geben können, aber sie verstehen den Kontext nicht. Auch wenn es den Anschein hat, dass Sie eine menschenähnliche Konversation mit einem Chatbot führen, gibt dieser nur Antworten, die auf den vorhandenen Daten basieren, die ihm sagen, dass die nächste Antwort sein sollte. ChatGPT ist nicht in der Lage, selbstständig zu denken oder Ideen zu interpretieren, und er kann auch nicht wesentlich über das hinausgehen, was bereits zu einem Thema erstellt wurde. Aus diesem Grund ist es nicht in der Lage, über ein Briefing hinauszugehen, so wie es Menschen können.

Allerdings kann die KI Ihnen helfen, eine Antwort zu finden, wenn Sie die richtige Frage stellen. Wenn Sie die KI zum Beispiel bitten, einfach eine Pressemitteilung zu schreiben, werden Sie wahrscheinlich etwas Routinemäßiges und Uninspiriertes erhalten. Handelt es sich um eine Produkt-Pressemitteilung? Wer ist die Zielgruppe? Und wer sind die wichtigsten Konkurrenten? Die Spezifität der Frage, gepaart mit dem richtigen Datentrainingssatz, führt zu besseren Ergebnissen.

Unabhängig vom Anwendungsfall kann KI, wenn sie verantwortungsbewusst und mit Bedacht eingesetzt wird, den Praktikern helfen, intelligenter und nicht härter zu arbeiten.

Wichtige KI-Begriffe kurz erklärt:

Künstliche Intelligenz, kurz KI, sind Computersysteme, die in der Lage sind, Aufgaben auszuführen, die normalerweise menschliche Intelligenz erfordern, z. B. visuelle Wahrnehmung, Spracherkennung, Entscheidungsfindung und Übersetzung zwischen Sprachen.

Chatbots sind eine spezielle Art von Software, die darauf ausgelegt ist, menschenähnliche Gespräche zu führen, vornehmlich über Online-Kanäle. Sie können sich einen Chatbot als einen virtuellen Gesprächspartner vorstellen, der rund um die Uhr verfügbar ist.

Ein gutes Anwendungsbeispiel für Chatbots ist der Kundenservice. Hier können sie Anfragen entgegennehmen und sofortige Antworten liefern, was die Wartezeit für Kunden erheblich reduziert.

Auch im Bildungsbereich können Chatbots eingesetzt werden, wo sie als interaktive Lernhilfen dienen, die Schülern und Studenten dabei helfen, komplexe Themen zu verstehen und zu vertiefen.

ChatGPT ist ein vom Unternehmen OpenAI entwickeltes KI-Sprachmodell, das in der Lage ist, auf der Grundlage der ihm gegebenen Eingaben menschenähnlichen Text zu erzeugen.

DALLE-2, MidJourney, Stable Diffusion sind KI-Anwendungen, die Bilder aus einer vom Benutzer eingegebenen Textbeschreibung generieren.

Deepfake bezeichnet durch Künstliche Intelligenz erzeugte Medieninhalte, die eine verfälschte Realität darstellen. Ein typisches Beispiel sind Videos, in denen das Gesicht einer Person auf den Körper einer anderen montiert wird, oder auch täuschend echte "Fotografien" von Personen, die in Wirklichkeit gar nicht existieren. Stellen Sie sich vor, Sie sehen ein Video von einem berühmten Schauspieler, der eine Rede hält, die er nie gehalten hat, oder ein Foto von einer Person, die so real aussieht, als könnte sie Ihr Nachbar sein, obwohl sie nie geboren wurde. Das sind Deepfakes.

Large Language Model (LLM) sind Algorithmen, die auf einem Korpus von Inhalten trainiert wurden und entwickelt wurden, um Texte zu produzieren, Fragen in natürlicher Sprache zu beantworten oder Material von einer Sprache in eine andere zu übersetzen.

Predictive Analytics ist ein Prozess, bei dem Daten zusammen mit statistischen Algorithmen und maschinellem Lernen genutzt werden, um Vorhersagen über zukünftige Ereignisse oder Ergebnisse zu treffen, basierend auf den Informationen, die wir aus der Vergangenheit haben.

Sentiment Analysen sind Prozesse, bei dem Techniken aus den Bereichen natürliche Sprachverarbeitung, Textanalyse und Computerlinguistik eingesetzt werden, um subjektive Informationen, wie zum Beispiel positive oder negative Stimmungen, systematisch zu erkennen und zu messen.

Synthetische Medien bezeichnen Inhalte, die mithilfe von künstlicher Intelligenz oder anderen digitalen Technologien erzeugt oder modifiziert wurden. Dazu gehören beispielsweise Deepfakes, also manipulierte Videos, oder auch computergenerierte Bilder und Texte. Diese Medien können so realistisch sein, dass sie oft kaum von echten Inhalten zu unterscheiden sind.

Was Sie noch interessieren könnte

➡️ Best Practice: PR-Profis aufgepasst: 5 Erkenntnisse aus dem Global Comms Report

➡️ Whitepaper: Trends in der Kommunikation 2023 - kostenlos herunterladen.